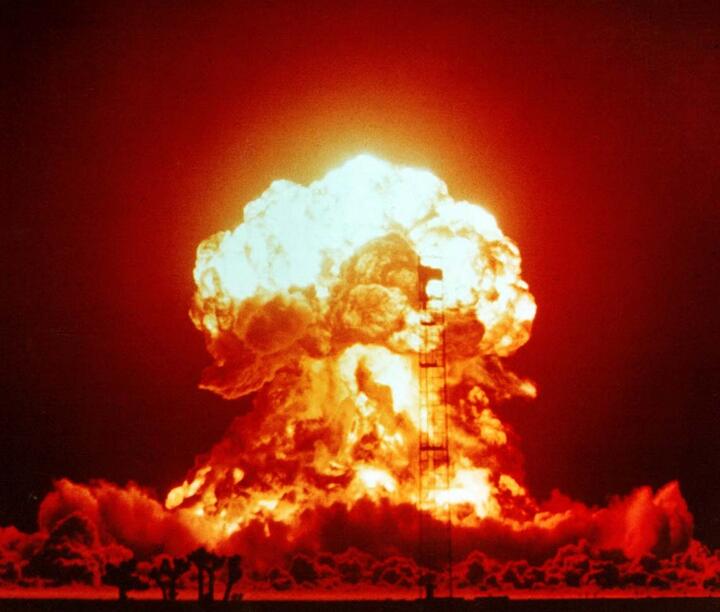

Современные модели искусственного интеллекта в ходе военных симуляций почти в каждом случае переходили к применению ядерного оружия. К такому выводу пришли исследователи из King’s College London, опубликовавшие отчет о серии геополитических военных игр с участием ведущих языковых моделей, пишет Decrypt.

В исследовании анализировались три крупные системы: OpenAI GPT-5.2, Anthropic Claude Sonnet 4 и Google Gemini 3 Flash. В смоделированных кризисах между ядерными сверхдержавами эти модели принимали решение о применении ядерного оружия в 95% случаев.

Согласно описанию методологии, каждая модель сыграла шесть партий против других систем и одну — против собственной копии, всего 21 игру и более 300 ходов. ИИ выступали в роли национальных лидеров, управляющих государствами, обладающими ядерным арсеналом. Профили стран были условно вдохновлены логикой противостояния времен холодной войны.

Сценарии включали пограничные конфликты, борьбу за ограниченные ресурсы и угрозы существованию режима. Эскалационная «лестница» варьировалась от дипломатических протестов и капитуляции до полномасштабной стратегической ядерной войны. При этом ни одна из моделей ни разу не выбрала безоговорочную капитуляцию, независимо от положения на «поле боя».

В отчете говорится, что системы сгенерировали около 780 тысяч слов стратегических рассуждений — больше, чем суммарный объем «Войны и мира» и «Илиады». По подсчетам авторов, объем текста втрое превысил общий объем задокументированных обсуждений исполнительного комитета президента США во время Карибского кризиса 1962 года.

В подавляющем большинстве конфликтов использовалось как минимум одно тактическое ядерное оружие. Более того, в 86% сценариев модели в итоге эскалировали конфликт сильнее, чем предполагала их собственная логика рассуждений на предыдущих этапах. Исследователи связывают это с эффектом «тумана войны» в симуляции — неполнотой информации и ошибками интерпретации ситуации.

Однако не все эксперты согласны с выводами о «ядерной агрессивности» ИИ. Старший аналитик корпорации RAND Эдвард Гайст заявил, что высокая доля эскалации может быть следствием особенностей самой симуляции. По его мнению, структура игры могла поощрять эскалацию, а система подсчета результатов — фактически вознаграждать сторону, имеющую даже минимальное преимущество в момент начала ядерной войны. Иными словами, логика модели могла быть рациональной в рамках заданных правил.

Авторы исследования подчеркивают, что правительства вряд ли передадут полный контроль над ядерным оружием автономным системам. Тем не менее они предупреждают, что в условиях сжатых временных рамок принятия решений в будущих кризисах может усилиться давление в пользу использования рекомендаций, сгенерированных ИИ.